巴克萊認為,隨着服務器機架功率密度急劇攀升,冷卻系統的重要性已可與電力供應並列。冷卻系統約佔數據中心建築外殼資本支出的10-15%,且這一比例仍在上升。與此同時,水資源的可獲取性、以及勞動力短缺,正在共同重塑整個供應鏈。

AI算力擴張正將數據中心的基礎設施矛盾推向新的臨界點。電力之外,冷卻系統、水資源消耗與勞動力短缺正在成為制約下一輪數據中心建設的關鍵因素。

據硬AI,5月13日,巴克萊William Thompson團隊研報指出,隨着服務器機架功率密度急劇攀升,冷卻系統的重要性已可與電力供應並列。

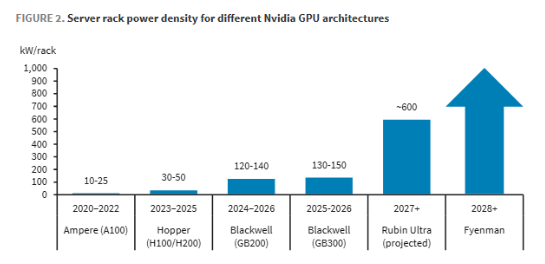

英偉達GPU機架功率密度從2020年的10-25千瓦/機架躍升至Blackwell架構的120-150千瓦/機架,並預計在2027年後的Rubin Ultra架構中突破600千瓦/機架,冷卻系統是制約AI數據中心落地速度的核心變量之一。

(不同英偉達顯卡架構對應的服務器機架功率密度)

冷卻系統約佔數據中心建築外殼資本支出的10-15%,且這一比例仍在上升。與此同時,水資源的可獲取性、以及勞動力短缺,正在共同重塑整個供應鏈的投資機會與風險格局。

冷卻是數據中心的核心基礎設施

數據中心服務器本質上是"電力鍋爐",幾乎所有流經IT設備的電能最終都轉化為廢熱。冷卻失效意味着性能下降、設備損毀乃至業務中斷。

隨着AI工作負載主導數據中心運營,冷卻系統在資本支出中的佔比正在上升。

巴克萊估計,冷卻約佔數據中心基礎設施建設成本的10%至15%,並預計這一比例將隨液冷架構的普及持續擴大。

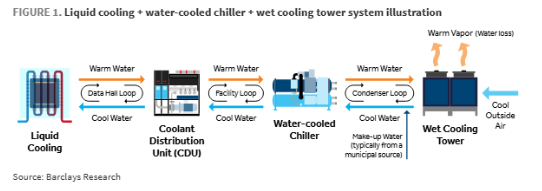

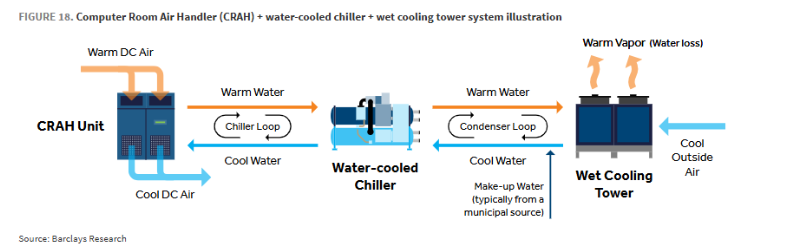

冷卻系統的核心工作分為兩步:首先是從芯片和服務器中提取熱量,其次是將熱量排放至外部環境。

(液體冷卻+水冷式製冷機+溼式冷卻塔系統的示意圖)

前者可通過空氣、液體或相變製冷劑實現;後者則包括直接排氣、風冷冷凝或蒸發冷卻等多種路徑,其中蒸發冷卻是數據中心直接耗水的主要來源。

一個普遍存在的投資者誤解在於,將液體冷卻等同於數據中心高耗水的根源。

巴克萊指出,液冷系統通常在封閉迴路中運行,冷卻液一旦注入便持續循環,正常運營期間不產生淨消耗。

事實上,液體冷卻可以通過提高冷卻液供水溫度,在很多情況下減少乃至消除對蒸發冷卻的依賴,從而降低直接水耗。

蒸發冷卻纔是直接耗水的主因,水在蒸發過程中吸收熱量並以水蒸氣形式散失至大氣,形成持續性水資源消耗。

數據中心水足跡遠超直接冷卻耗水

數據中心的水消耗問題比通常認知的更為複雜。

據美國能源部數據,美國數據中心直接冷卻水耗從2014年約210億升增至2023年約660億升,年均增速約12%至13%。

若數據中心容量持續擴張,美國能源部預測到2028年這一數字可能增至每年1450億至2750億升。

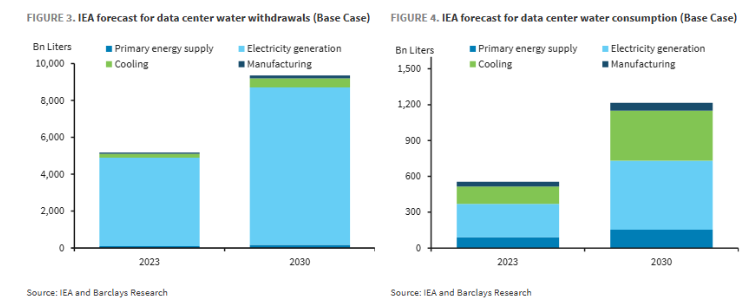

然而,直接冷卻水耗僅是冰山一角。更大體量的耗水來源於支撐數據中心運營的發電環節——燃氣、燃煤、核能等熱電廠均需大量冷卻用水。

以2023年美國數據中心約176太瓦時的電力需求為例,對應的間接水耗接近8000億升。國際能源署(IEA)估計,全球數據中心綜合冷卻、發電及半導體供應鏈的年取水量約為5.2萬億升。

(基準情景下,國際能源署對數據中心用水量的預測)

Meta披露的數據頗具說明性:該公司2024年購電所嵌入的間接水耗超過720億升,而直接現場取水量僅為56億升,兩者相差近13倍。

這一比例差距說明,數據中心運營商在評估水資源影響時,若僅關注現場水耗效率指標(WUE),將大幅低估其實際水足跡。

不同發電技術的耗水強度差異顯著,但隨着電網持續去碳化,發電側的間接水耗強度有望逐步下降。

傳統煤電廠每千瓦時取水量約70升,部分老式核電站的一次性冷卻取水量甚至超過每千瓦時100升;現代天然氣聯合循環電廠僅約10至12升;風能和太陽能光伏則幾乎不需冷卻取水。

超大規模雲廠商的冷卻策略正在分化

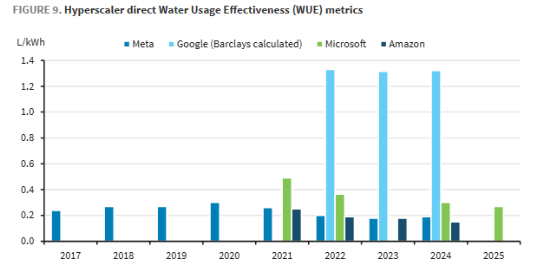

四大超大規模運營商在冷卻策略上出現顯著分歧,這對設備供應商的選擇具有直接影響。

(超級雲計算公司的用水效率指標對比)

微軟已啓用以風冷冷水機為核心的零蒸發冷卻數據中心設計,目標是2030年前實現全球運營水資源"正效益",同時將WUE較2022年基準改善40%。

該公司2024財年水資源提取量按年下降約20%至約104億升,WUE(水使用效率)為0.27升/千瓦時,較2022年基準提升18%。

Meta路徑相似。Meta最新一代AI數據中心以直接液冷結合乾式冷卻器為核心,正常冷卻過程中幾乎不消耗水資源。

儘管2024年電力需求增長約21%,其取水量僅上升約7%至56億升,WUE為0.19升/千瓦時,其Beaver Dam威斯康星州數據中心全年耗水量甚至少於兩家餐廳的消耗。

谷歌的策略則明顯不同。巴克萊根據谷歌披露的電力消耗與取水數據測算,谷歌有效WUE超過約1.3升/千瓦時,顯著高於同行。

2024年數據中心取水量約420億升,按年增長約27%,與其電力需求增速完全同步。

谷歌堅持在低水資源風險地區部署蒸發冷卻,理由是此舉可降低電耗及相關間接用水和碳排放。

不過,谷歌在高水資源壓力地區已放棄蒸發冷卻,包括亞利桑那州梅薩、烏拉圭卡內洛內斯和英國沃爾瑟姆十字鎮的數據中心均採用風冷設計。

亞馬遜方面,全球WUE 2024年按年改善17%至0.15升/千瓦時,AWS聲明蒸發冷卻可在夏季峯值期間降低25-35%的能耗。

亞馬遜同樣採用區域差異化策略,在高水資源風險地區避免水冷設計。

五大投資誤區被逐一擊破

報告專門針對市場上普遍存在的認知錯誤進行了糾偏,這對於評估相關設備企業的投資價值至關重要:

液冷≠用水多:如前所述,蒸發冷卻纔是主要耗水源;液冷反而有助於節水。

浸沒冷卻並非終局:直接芯片液冷(D2C)已成為超大規模部署標準;浸沒冷卻因運維複雜、OEM生態支持不足、兩相系統面臨PFAS監管壓力等問題,仍屬小衆方案。

風冷不會消失:除全浸沒冷卻外,網絡設備、內存、存儲等仍依賴風冷;液冷數據中心是混合架構,風冷將長期共存。

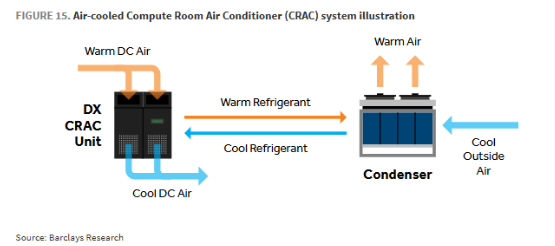

(風冷式計算機機房空調系統示意圖)

冷水機需求未被顛覆:英偉達CEO黃仁勳"45°C供液溫度無需冷水機"的表態被市場過度解讀,導致HVAC設備股短暫承壓。

但在炎熱氣候、季節性峯值及冗餘需求下,冷水機仍不可或缺。同時,隨着運營商從溼冷塔轉向風冷方案,風冷冷水機需求有望進一步增長。

(計算機房空氣處理機組+C型水冷式製冷機+溼式冷卻塔系統的示意圖)

LG Electronics預測數據中心風冷及液冷冷水機市場規模將從2026年的16億美元擴張至2030年的127億美元。

餘熱利用難以規模化:受溫度不匹配、市政協調複雜及資本投入高等制約,餘熱回用主要在北歐區域供熱體系中具備條件,不會成為冷卻系統設計的主流考量。

勞動力短缺:被低估的工期與成本風險

冷卻系統的安裝高度依賴現場專業技工,是數據中心各子系統中勞動密集程度最高的環節。

液冷迴路或冷水機組的安裝涉及複雜的泵、閥門、熱交換器和定製管道網絡,需要水管工、管道安裝工、暖通空調技術員、焊工、電氣工程師及調試工程師等多工種協同作業。

這與插接預製電力模塊或服務器機架的標準化作業截然不同。

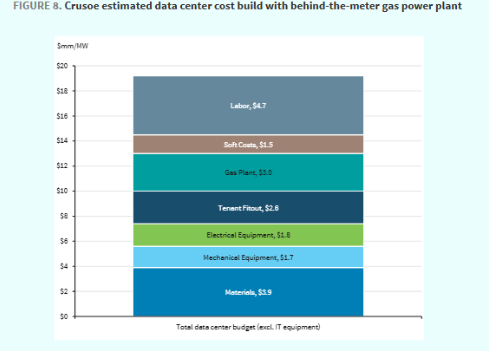

Crusoe是美國德克薩斯州阿比林星際之門項目的開發商,據該公司CEO Chase Lochmiller在斯坦福大學的公開演講中披露,數據中心開發的勞動力成本約為每兆瓦470萬美元,約佔含自備電廠總成本的25%。

(Crusoe披露的數據中心建設成本佔比)

他指出,星際之門工地日均工人數量約9000人,另一處德克薩斯州Claude項目的工人數量達3500人,超過該鎮總人口的兩倍。由於項目地處偏遠,Crusoe不得不從其他地區招募工人並提供大量留人激勵。

勞動力短缺帶來多重風險與機會:

一是進度風險,人員不足可能導致冷卻系統安裝、調試等關鍵節點延誤,進而推遲數據中心投產;

二是成本通脹,激烈的工種競爭正推高工資水平及分包商報價;

三是技術取捨,部分開發商在選擇冷卻方案時開始將施工難度納入權衡,在勞動力受限情況下可能優先選擇更為簡單的風冷設計;

四是模塊化解決方案的機遇,預製化冷卻單元可減少現場專業技工需求,有助於壓縮工期、降低執行風險。